《大数据产业生态联盟2020中国大数据产业发展白皮书》解读 软件开发的新机遇与挑战

在数字化浪潮席卷全球的背景下,大数据已成为推动社会进步和产业升级的核心驱动力。由大数据产业生态联盟发布的《2020中国大数据产业发展白皮书》(以下简称《白皮书》),不仅全面梳理了我国大数据产业的发展现状与趋势,更为软件开发领域揭示了新的机遇与挑战。本文将从软件开发的角度,对《白皮书》进行深入解读。

一、 大数据产业发展为软件开发创造新需求

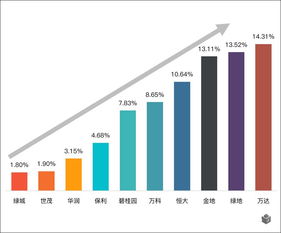

《白皮书》指出,2020年中国大数据产业规模持续扩大,数据资源日益丰富,数据应用场景不断深化。这直接催生了海量、多样化的软件开发需求。

- 数据采集与处理工具开发需求激增:随着物联网、5G等技术的普及,数据来源呈爆炸式增长。开发高效、稳定、安全的数据采集、清洗、集成与预处理软件,成为支撑大数据价值链的基础。对分布式采集框架、实时流处理引擎(如Flink、Spark Streaming)的开发与优化提出了更高要求。

- 数据分析与挖掘平台成为关键:企业从“拥有数据”转向“用好数据”。《白皮书》强调数据分析与智能决策的重要性。因此,能够提供机器学习、深度学习、可视化分析等功能的软件开发平台(如低代码/无代码AI平台、交互式分析工具)需求旺盛。开发这类平台需要深厚的算法功底和工程化能力。

- 数据安全与隐私保护软件地位凸显:随着《数据安全法》、《个人信息保护法》等法规的出台与完善,《白皮书》特别关注数据安全治理。这推动了对数据加密、脱敏、访问控制、安全审计、隐私计算(如联邦学习、安全多方计算)等相关软件和解决方案的迫切开发需求。

二、 软件开发技术演进与大数据产业深度融合

《白皮书》展示了大数据技术体系的演进,软件开发方法和技术栈也需随之迭代。

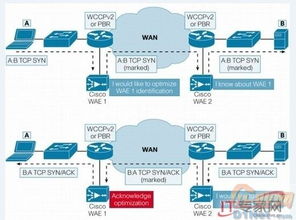

- 云原生与微服务架构成为主流:为应对大数据应用的高并发、高弹性需求,基于容器(Docker)、编排(Kubernetes)和微服务架构的云原生开发模式,正成为构建大数据平台和应用的标准。这要求开发者掌握相关的开发、部署与运维技能。

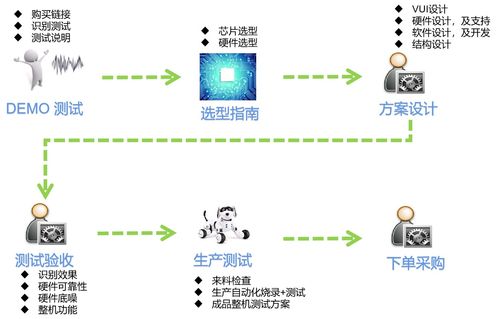

- AI驱动的软件开发初现端倪:《白皮书》提及人工智能与大数据的融合。AI技术本身也开始应用于软件开发环节,如自动代码生成、智能测试、缺陷预测等,有望提升大数据相关软件的开发效率与质量。

- 开源生态占据核心地位:Hadoop、Spark、Kafka等开源项目构成了大数据技术的基石。《白皮书》肯定了中国企业在开源社区的贡献。软件开发越来越依赖于对开源技术的理解、应用、定制化开发与反哺,参与开源生态成为开发者重要的能力维度。

三、 面临的挑战与未来展望

尽管机遇巨大,《白皮书》也暗示了软件开发面临的挑战。

- 复合型人才短缺:能够同时精通分布式系统架构、大数据核心技术、特定领域业务知识以及先进算法模型的复合型软件开发人才严重不足。这成为制约产业发展的瓶颈之一。

- 技术集成与工程化难度高:将多样化的数据源、复杂的处理框架、智能的分析模型以及易用的前端界面无缝集成,并实现稳定、高效的工程化部署与运维,对软件开发的全流程管理能力提出了极高挑战。

- 标准化与规范化有待加强:数据格式、接口、质量、安全等方面的标准仍在发展中,增加了软件开发的复杂性和互操作性成本。

根据《白皮书》的指引,软件开发将更加紧密地围绕数据价值化展开。趋势包括:

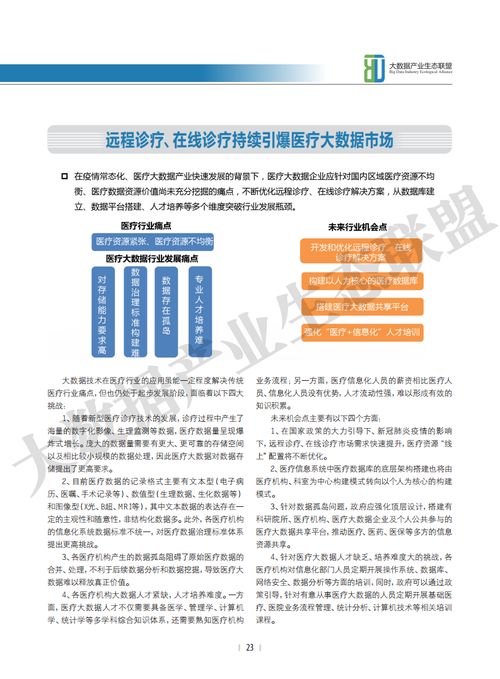

- 场景化与垂直化:软件开发将更深度地嵌入金融、工业、医疗、政务等具体场景,提供端到端的解决方案。

- 智能化与自动化:从数据管理到应用开发,AI将扮演更重要的角色,推动软件开发过程的智能化升级。

- 安全可信与合规优先:安全和隐私保护将作为核心特性,内置于软件开发的每一个阶段。

总而言之,《2020中国大数据产业发展白皮书》为软件开发行业描绘了一幅清晰的蓝图。开发者与软件企业唯有紧跟技术趋势,深耕应用场景,强化核心能力,才能在波澜壮阔的大数据时代,抓住机遇,交付真正创造价值的数据驱动型软件产品。

如若转载,请注明出处:http://www.aikua6.com/product/63.html

更新时间:2026-04-16 04:56:15